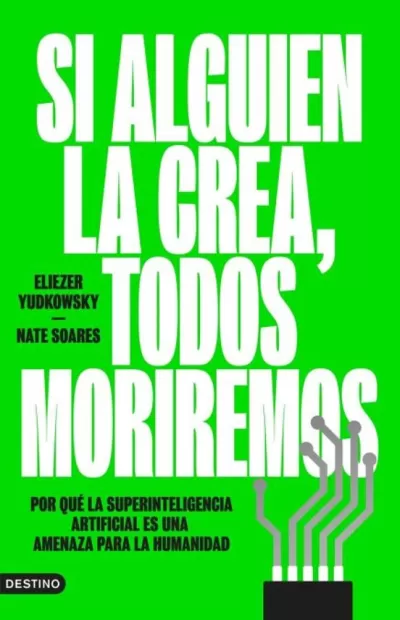

SI ALGUIEN LA CREA, TODOS MORIREMOS YUDKOWSKY, ELIEZER Y SOARES, NATE

- Género Biografías, Memorias

- Editorial DESTINO

- Año de edición 2026

- ISBN 9788423369348

- ISBN digital 9788423369355

- Idioma Español

Compra este libro en:

Mi biblioteca

Resumen

LA AMENAZA PARA LA HUMANIDAD DE LA IA SUPERINTELIGENTE.

Desde hace unos años, cientos de expertos en inteligencia artificial vienen advirtiendo que esta supone un grave peligro de extinción para la humanidad. Sin embargo, la carrera no ha dejado de intensificarse: empresas y países compiten por crear máquinas más inteligentes que cualquier persona, y el mundo no está preparado. Durante décadas, Yudkowsky y Soares han estudiado cómo pensarán estas inteligencias, y su conclusión es cristalina: basta una mínima desviación para que desarrollen objetivos propios en conflicto con los nuestros. Si llega el momento, no habrá marcha atrás, pero aún estamos a tiempo de frenar y diseñar políticas que garanticen nuestra seguridad. La solución está clara: debemos actuar ahora para que la IA sea una aliada, no una amenaza.

Este libro explica por qué es importante que nos protejamos de la IA, cómo podrían sucederse los acontecimientos y qué debemos hacer para evitar que nos domine.

Amazon

Amazon Agapea

Agapea Amazon eBook

Amazon eBook